Linux之wget命令

入门小站 -Linux系统中的wget是一个下载文件的工具,它用在命令行下。对于Linux用户是必不可少的工具,我们经常要下载一些软件或从远程服务器恢复备份到本地服务器。wget支持HTTP,HTTPS和FTP协议,可以使用HTTP代理。

wget 可以跟踪HTML页面上的链接依次下载来创建远程服务器的本地版本,完全重建原始站点的目录结构。这又常被称作”递归下载”。在递归下载的时候,wget 遵循Robot Exclusion标准(/robots.txt). wget可以在下载的同时,将链接转换成指向本地文件,以方便离线浏览。wget 非常稳定,它在带宽很窄的情况下和不稳定网络中有很强的适应性.如果是由于网络的原因下载失败,wget会不断的尝试,直到整个文件下载完毕。如果是服务器打断下载过程,它会再次联到服务器上从停止的地方继续下载。这对从那些限定了链接时间的服务器上下载大文件非常有用。安装方式有些最小安装的Linux系统可能没有安装上

wget命令,可以自行安装CentOS> yum install wget -ysudo apt-get install -y wgetwget [参数][URL]

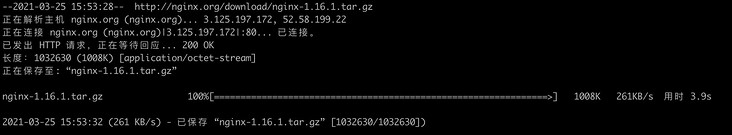

> wget http://nginx.org/download/nginx-1.16.1.tar.gz

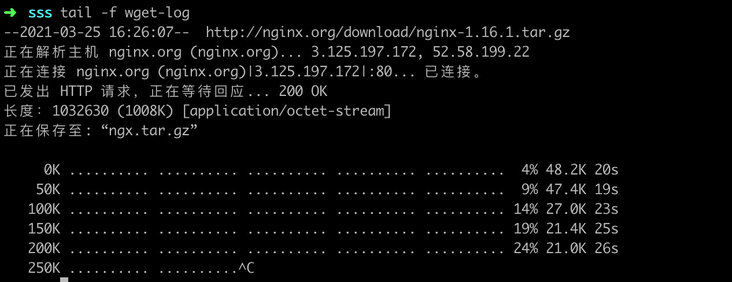

> wget http://nginx.org/download/nginx-1.16.1.tar.gz -O ngx.tar.gz> wget --limit-rate 300 http://nginx.org/download/nginx-1.16.1.tar.gz -O ngx.tar.gz> wget -c http://nginx.org/download/nginx-1.16.1.tar.gz -O ngx.tar.gzwget -b后台下载> wget -b http://nginx.org/download/nginx-1.16.1.tar.gz -O ngx.tar.gz

继续在后台运行,pid 为 64780。

将把输出写入至 “wget-log”。

> wget --user-agent="Mozilla/5.0 (Windows; U; Windows NT 6.1; en-US) AppleWebKit/534.16 (KHTML, like Gecko) Chrome/10.0.648.204 Safari/534.16" http://nginx.org/download/nginx-1.16.1.tar.gz -O ngx.tar.gz> cat urls.txt

https://rumenz.com/rumenbiji/1.zip

https://rumenz.com/rumenbiji/2.zip

https://rumenz.com/rumenbiji/3.zip

https://rumenz.com/rumenbiji/4.zip

> wget -i urls.txt> wget --mirror -p --convert-links -P ./LOCAL URL> wget -r -A.pdf rumenz.com> wget ftp-url

> wget --ftp-user=USERNAME --ftp-password=PASSWORD url--no-check-certificate选项:> wget --no-check-certificate https://rumenz.com/rumenbiji/1.zip.wgetrc文件。文件中可以设置代理服务器> vim ~/.wgetrc

http-proxy = 8.8.8.8:8080

ftp-proxy = 8.8.8.111:8080#### 如果代理服务器需要密码则使用

–proxy-user=USER设置代理用户

–proxy-passwd=PASS设置代理密码原文链接:https://rumenz.com/rumenbiji/...

微信公众号:入门小站

特别申明:本文内容来源网络,版权归原作者所有,如有侵权请立即与我们联系(cy198701067573@163.com),我们将及时处理。

Tags 标签

linuxwget扩展阅读

Linux 常用命令

2019-01-12 11:26:35 []linux命令行查看系统有哪些用户

2020-06-28 19:09:43 []【问题合集】Problem with the SSL CA cert (path? access rights?)

2020-09-20 09:57:21 []关于 MAC 配置 Apache2 + PHP

2020-09-21 12:36:34 []Laravel项目上线注意点

2020-10-20 21:55:08 []PHP-FPM中-D命令的实现

2020-10-23 13:54:26 []2020年10月php面试笔记

2020-10-23 01:09:55 []协程 shell_exec 如何捕获标准错误流

2020-11-03 10:11:33 []亲测三遍!8步搭建一个属于自己的网站

2020-11-15 11:37:21 []lnmp.org如何更改TP6.0框架的pathinfo模式.

2020-11-15 15:21:36 []加个好友,技术交流